Higress:云原生API网关的AI原生能力深度解析

引言:AI时代下的API网关新范式

随着AI技术的爆发式增长,企业对API网关的需求已从传统的流量管理转向对AI业务的原生支持。Higress作为一款云原生API网关,凭借其基于Istio与Envoy的核心架构,以及创新的Wasm插件扩展机制,正在重新定义AI场景下的网关能力。本文将深入解析Higress如何通过统一协议对接、动态插件扩展、生产级稳定性等特性,成为支撑大模型应用的关键基础设施。

核心优势:为什么选择Higress?

1. 生产级稳定性与性能

-

大规模验证:源自阿里巴巴内部两年多的生产实践,支撑数十万级QPS场景 -

零抖动更新:彻底解决传统网关Reload导致的流量抖动问题,配置变更毫秒级生效 -

资源效率:相比传统Java网关,资源消耗降低50%以上,路由生效速度提升10倍

2. 原生AI能力支持

-

全模型兼容:支持OpenAI、通义千问、DeepSeek等国内外主流模型,覆盖vllm/ollama自建模型 -

流式处理优化:原生支持SSE协议,实现大模型响应数据的低内存流式处理 -

智能流量治理:提供多模型负载均衡、Fallback策略、Token级限流等AI专属功能

3. 安全易用的扩展体系

-

Wasm插件生态:支持Go/Rust/JS等多语言开发,200+官方插件开箱即用 -

动态热更新:插件版本独立升级,业务流量完全无损 -

企业级安全:集成WAF防护,支持JWT/OIDC等多种认证方式

快速部署:5分钟搭建AI网关

Docker本地部署

mkdir higress; cd higress

docker run -d --rm --name higress-ai -v ${PWD}:/data \

-p 8001:8001 -p 8080:8080 -p 8443:8443 \

higress-registry.cn-hangzhou.cr.aliyuncs.com/higress/all-in-one:latest

端口说明:

-

8001: 控制台入口 -

8080: HTTP网关入口 -

8443: HTTPS网关入口

核心场景解析

场景一:统一AI模型网关

-

协议转换:统一处理HTTP/HTTPS/gRPC等协议接入 -

智能路由:根据模型类型、地域、负载状态自动选择最优服务节点 -

观测体系:实时监控模型调用延迟、Token消耗、错误率等关键指标

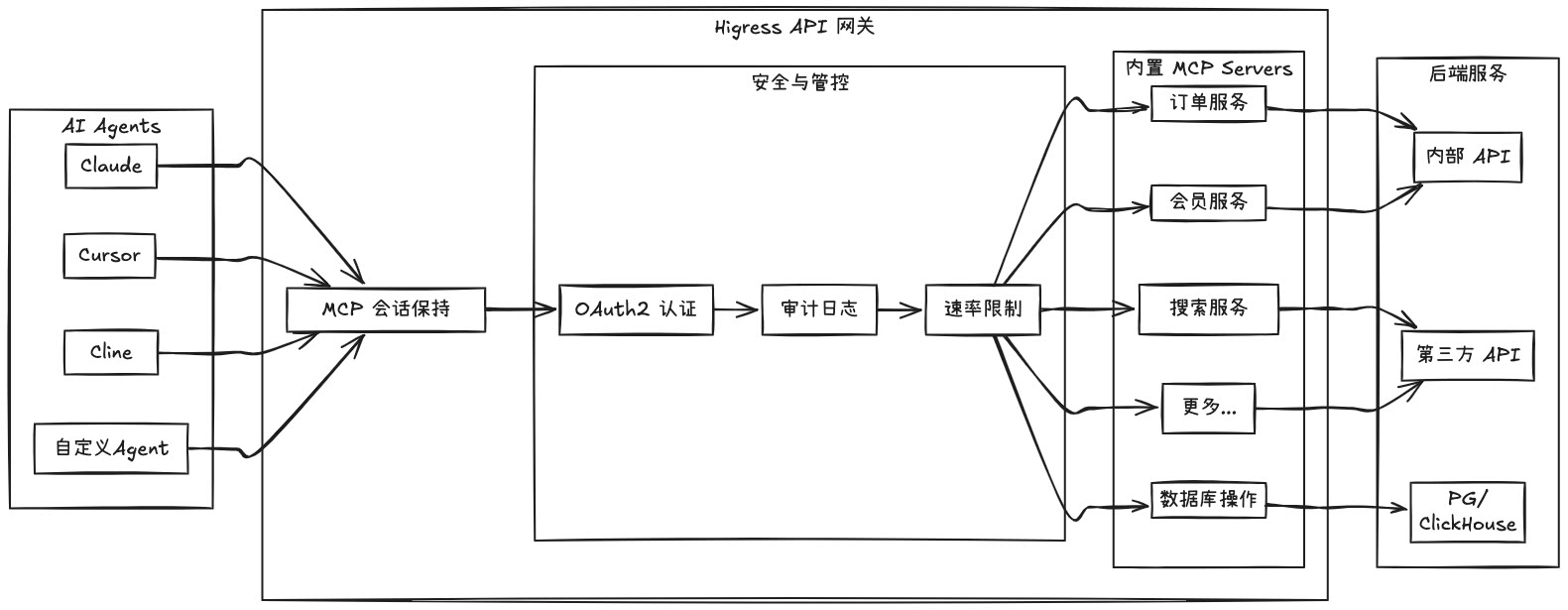

场景二:MCP Server托管

-

认证鉴权:统一管理工具调用的API Key与访问权限 -

流量治理:实现基于QPS、并发连接数等多维度限流 -

审计追踪:完整记录所有AI工具调用日志,满足合规要求

场景三:Kubernetes Ingress

-

平滑迁移:兼容80%以上Nginx Ingress注解配置 -

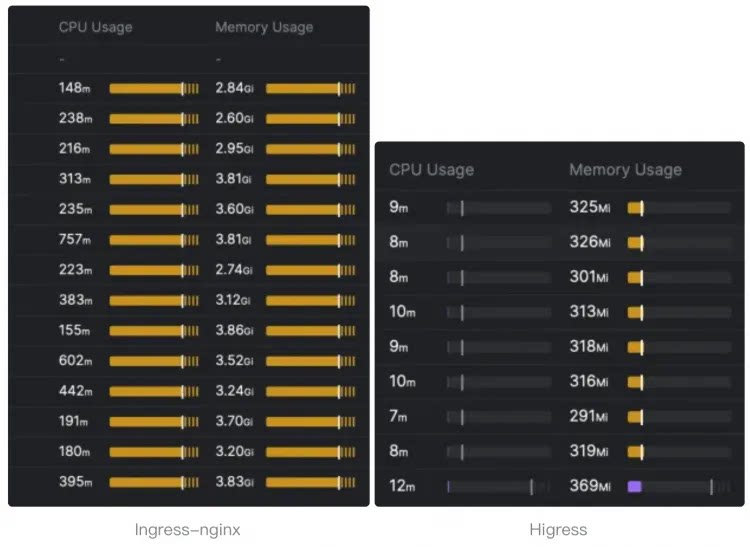

性能对比: -

路由规则生效速度:<100ms (传统方案>1s) -

内存占用:降低60%以上

-

-

标准支持:完整实现Gateway API规范

功能全景演示

控制台核心功能

1. 立体化监控

-

实时展示QPS、延迟、错误率等50+监控指标 -

支持Prometheus/Grafana深度集成

2. 插件市场

-

预置AI代理、限流降级、安全防护等插件 -

支持自定义Wasm插件动态加载

3. 路由管理

-

支持Header/Cookie/Path等多种匹配条件 -

灰度发布、AB测试等高级路由策略

企业级实践案例

案例1:通义千问APP

-

挑战:日均API调用量超10亿次,长连接保持要求>99.99% -

方案: -

采用Higress动态路由实现多地模型服务智能调度 -

通过Wasm插件实现流式响应压缩,带宽成本降低40%

-

-

成效:全年可用性99.995%,异常请求拦截率99.9%

案例2:零一万物大模型平台

-

需求:同时对接10+模型供应商,需统一认证与计费 -

实施: -

构建统一API网关层,标准化模型调用协议 -

开发定制插件实现Token消耗计量

-

-

结果:模型切换耗时从小时级降至秒级,运维成本降低70%

总结与展望

Higress通过深度整合云原生技术与AI工程化需求,正在重塑API网关的技术边界。其核心价值体现在三个维度:

-

技术融合:将Envoy的高性能与Wasm的灵活性完美结合 -

场景深化:从基础流量管理演进到AI原生支持 -

生态开放:构建开发者友好的插件体系与社区生态

随着大模型应用的普及,Higress在模型服务治理、边缘AI计算等领域的创新值得期待。企业可通过官网控制台快速体验,或参考部署指南开启生产实践。