Dolphin:突破性多语言语音识别模型的技术解析与应用指南

核心优势与技术亮点

覆盖全球语言版图

由Dataocean AI与清华大学联合研发的Dolphin模型,构建了当前最全面的东方语言识别体系:

-

40种区域语言:完整覆盖东亚、南亚、东南亚及中东地区主流语言 -

22种中文方言:支持包括粤语、吴语、闽南语等方言的精准识别 -

双级地理标识系统:首创 <语言代码>+<地区代码>组合标记(如<zh>+<CN>)

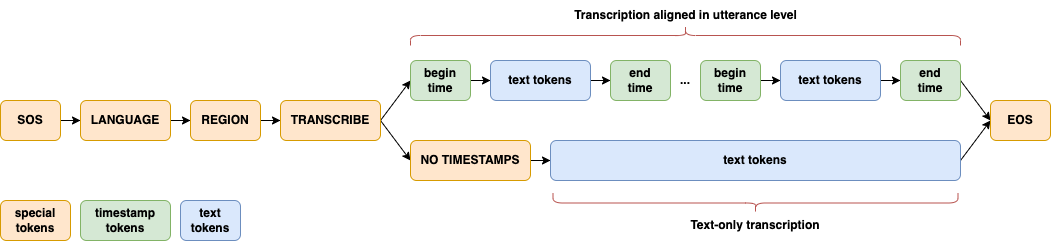

行业领先的模型架构

基于Whisper和OWSM的先进框架,Dolphin进行了三项关键改进:

-

联合CTC-注意力机制:采用E-Branchformer编码器与Transformer解码器组合 -

多任务处理引擎:集成语音识别(ASR)、语音活动检测(VAD)、语音分段和语言识别(LID) -

纯语音处理架构:去除翻译任务相关模块,专注语音转写核心功能

超大规模训练数据

模型基于超过210,000小时的混合数据集训练,包含:

-

Dataocean AI专有语音库 -

开源语音数据集 -

多场景噪声环境样本 -

长短语音混合素材(0.5秒至30分钟)

模型性能参数详解

四大版本对比

| 模型版本 | 参数量 | 平均WER | 可用状态 |

|---|---|---|---|

| base | 140M | 33.3% | 已开放 |

| small | 372M | 25.2% | 已开放 |

| medium | 910M | 23.1% | 待发布 |

| large | 1679M | 21.6% | 开发中 |

注:WER(Word Error Rate)数值基于混合测试集评估

语言支持明细

完整支持语言列表可参考官方语言文档,重点包含:

-

东亚:中文/日语/韩语/蒙古语 -

东南亚:越南语/泰语/缅甸语/马来语 -

南亚:印地语/孟加拉语/泰米尔语 -

中东:阿拉伯语/波斯语/土耳其语

环境配置与安装指南

系统依赖准备

# Ubuntu/Debian系统

sudo apt update && sudo apt install ffmpeg

# macOS系统

brew install ffmpeg

# Windows系统

choco install ffmpeg

模型安装方式

标准安装方法:

pip install -U dataoceanai-dolphin

源码编译安装:

pip install git+https://github.com/SpeechOceanTech/Dolphin.git

实战应用教程

命令行操作示例

# 基础语音识别

dolphin audio.wav

# 指定模型版本与存储路径

dolphin audio.wav --model small --model_dir /data/models/dolphin/

# 设置语言区域参数

dolphin audio.wav --lang_sym "zh" --region_sym "CN"

# 启用30秒音频填充

dolphin audio.wav --padding_speech true

Python API调用

import dolphin

# 加载音频文件

waveform = dolphin.load_audio("audio.wav")

# 初始化模型实例

model = dolphin.load_model(

model_size="small",

model_path="/data/models/dolphin",

device="cuda"

)

# 执行语音识别

result = model(waveform, lang_sym="zh", region_sym="CN")

print(f"识别结果:{result.text}")

关键技术解析

双级地理标识系统

为解决多语言场景中的方言差异问题,Dolphin创新性地采用:

-

语言级标记:定义基础语言类型(如 <zh>代表中文) -

地区级标记:指定区域变体(如 <CN>对应普通话,<TW>对应台湾口音)

音频预处理流程

-

自动转换为16kHz WAV格式 -

动态噪声抑制处理 -

智能语音分段(最长支持30分钟连续语音) -

实时语言类型检测

行业应用场景

跨国企业应用

-

多语言客服电话自动转录 -

跨国视频会议实时字幕 -

跨境电商语音搜索优化

方言保护计划

-

濒危方言语音数据库建设 -

地方戏曲数字化存档 -

少数民族语言教育辅助

智能硬件集成

-

多语言智能音箱 -

车载语音控制系统 -

工业巡检语音记录

模型优化建议

计算资源适配方案

| 设备类型 | 推荐模型 | 内存需求 | 推理速度 |

|---|---|---|---|

| 移动终端 | base | <2GB | 实时 |

| 桌面级GPU | small | 4-6GB | 3倍速 |

| 服务器集群 | medium | 12GB+ | 10倍速 |

精度提升技巧

-

添加 --padding_speech true参数改善短语音识别 -

明确指定 lang_sym和region_sym参数 -

保持环境噪声低于-20dB -

使用16bit/16kHz音频输入

开源生态与支持

开发者资源中心

授权协议说明

Dolphin代码与模型权重遵循Apache 2.0开源协议,允许:

-

商业用途 -

代码修改 -

专利授权 -

责任限制

通过持续的技术迭代,Dolphin致力于构建全球最完备的多语言语音识别基础设施,为数字时代的语言交流提供智能化解决方案。