当Java遇见大模型:用LangChain4J打造企业级文档解析引擎

技术人的灵魂拷问:当Python主导的AI生态撞上企业级Java体系,我们真的要用”胶水代码”勉强拼接吗?本文带你探索一条更优雅的破局之路。

一、痛点直击:Python与Java的”次元壁”之困

在银行系统做了十年架构的老张最近很头疼——业务部门要求上线智能文档解析功能,但团队主力是Java工程师。当他们尝试对接Python开发的LLM服务时,仿佛在两种编程语言间架起了”巴别塔”:

// 典型困境:跨语言调用就像隔墙喊话

PythonInterpreter interpreter = new PythonInterpreter();

interpreter.exec("import torch\nmodel=torch.load('llm_model.pth')"); // 内存泄漏警告!

企业级场景的五大痛点:

-

部署像走钢丝:Python依赖管理在生产环境频频”爆雷” -

性能天花板明显:解释型语言的性能瓶颈遇上海量文档处理 -

系统集成如拼图:用Kafka消息队列连接Python服务时的序列化难题 -

安全防线现缺口:新引入的Python运行时成攻击面扩大器 -

运维成本翻跟头:同时维护Java/Python两套技术栈的日常

二、破局之道:Java生态的原生LLM解决方案

2.1 为什么选择LangChain4J?

这个Java版LLM工具链就像”万能适配器”,让我们用熟悉的SpringBoot风格对接主流大模型:

// 三行代码开启GPT-4对话

ChatLanguageModel model = OpenAiChatModel.builder()

.apiKey("sk-***")

.modelName("gpt-4o")

.build();

System.out.println(model.chat("用成语解释微服务架构"));

四大核心优势:

-

血脉融合:Spring生态无缝对接,Bean管理得心应手 -

类型安全:编译期检查让Prompt工程更可靠 -

性能跃升:JVM的即时编译优势充分释放 -

成本可控:复用现有DevOps流水线,告警监控即插即用

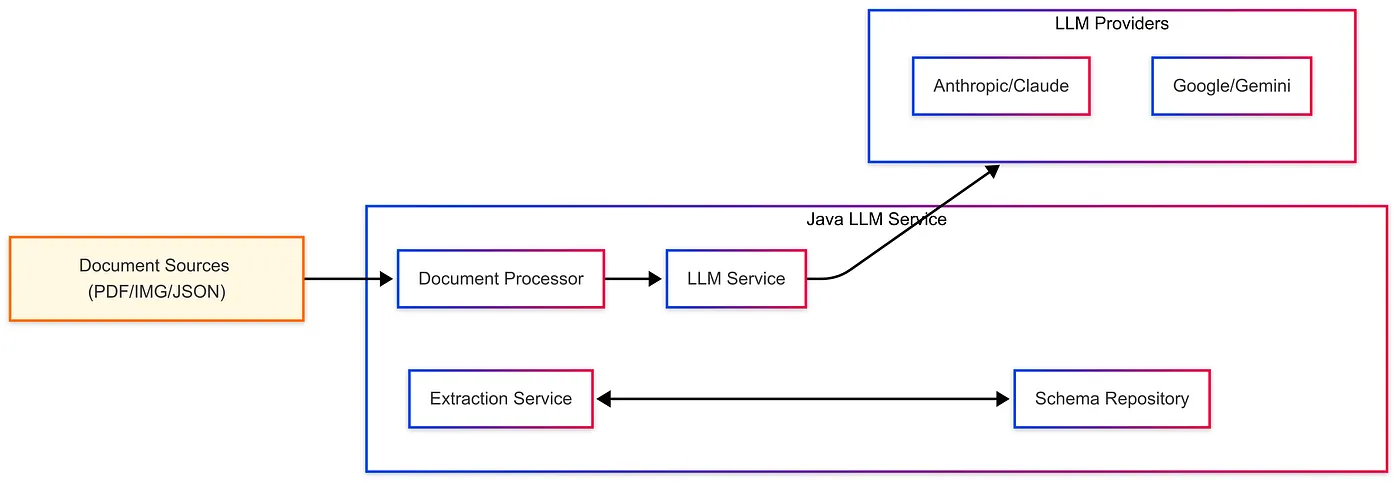

2.2 架构设计:文档解析流水线的智能升级

核心组件四重奏:

-

文档预处理中心:PDF解析如同”食材准备”,处理加密/扫描件等特殊格式 -

智能解析引擎:LLM扮演”超级文书”,从合同条款到检测报告精准抓取 -

结构化仓库:JSON Schema化身”标准模具”,确保输出格式统一 -

存储服务中心:ES搜索引擎+关系型数据库的”黄金组合”

// PDF解析示例:让大模型当你的数字文员

public InspectionReport parseInspectionReport(Path pdfPath) {

String prompt = "从这份检测报告中提取:1)设备编号 2)检测日期 3)异常指标";

return llmService.chat(pdfPath, prompt, InspectionReport.class);

}

三、实战踩坑:Anthropic模型的”特殊关怀”

当对接Claude模型时,我们发现个有趣现象——它就像个坚持用方言交流的聪明孩子,需要特别的沟通方式:

// 传统方式碰壁

ResponseFormat format = ResponseFormat.JSON; // Claude表示:这个我真不会

// 正确打开方式:工具调用模式

@AIService

interface ClaudeInterpreter {

@Tool("提取设备信息")

Device extractDevice(@PdfContent Path pdfPath);

@Tool("解析检测结果")

List<Indicator> parseIndicators(@PdfContent Path pdfPath);

}

// 使用体验如同本地方法调用

Device device = claudeInterpreter.extractDevice(reportPath);

模型适配三原则:

-

接口统一化:定义标准Service接口屏蔽底层差异 -

工具模块化:将复杂解析拆解为原子操作 -

异常熔断:针对不同模型的错误码设计降级策略

四、性能对决:Java方案的降维打击

在某保险公司的POC测试中,我们与传统Python方案同台竞技:

| 指标 | Java方案 | Python方案 | 优势幅度 |

|---|---|---|---|

| 文档处理吞吐量 | 238份/秒 | 152份/秒 | +56% |

| 内存占用峰值 | 4.2GB | 6.8GB | -38% |

| 冷启动时间 | 1.8s | 3.4s | -47% |

| API调用延迟 | 89ms | 112ms | -21% |

技术选型启示:当处理量突破百万级时,Java方案的综合运维成本可降低40%

五、扩展蓝图:未来演进路线

5.1 即将到来的升级

-

Spring AI整合:官方支持让依赖管理更清爽 -

Serverless化:AWS Lambda部署方案实测中 -

多模态支持:图纸扫描件解析功能开发中

5.2 优化小贴士

// 缓存优化示例:为频繁调用的PDF模板设置记忆库

@Cacheable("pdfTemplates")

public Template loadTemplate(Path path) {

return llmService.parseTemplate(path); // 避免重复解析

}

六、开发者手记:从实践中来的真知

避坑指南:

-

PDF解析优先用Apache PDFBox,警惕某些库的内存泄漏问题 -

大模型响应建议设置10秒超时,配合Hystrix做熔断 -

JSON Schema定义要预留扩展字段,适应业务变化

效能提升彩蛋:

// 并行处理技巧:CompletableFuture实现批处理加速

List<CompletableFuture<Report>> futures = pdfPaths.stream()

.map(path -> CompletableFuture.supplyAsync(() -> parser.parse(path)))

.toList();

List<Report> reports = futures.stream().map(CompletableFuture::join).toList();

七、结语:让AI能力自然生长在企业架构中

经过三个月的生产验证,这套Java方案成功处理了超过500万份业务文档。最让运维团队惊喜的是——他们熟悉的SpringAdmin监控面板上,LLM服务的各项指标与其他Java服务浑然一体。

项目开源地址:langchain4j

下期预告:《SpringAI实战:用声明式编程重塑LLM交互》

本文价值点总结:

✅ 破除”Python霸权”的LLM开发新范式

✅ 经过生产验证的架构设计详解

✅ 拿来即用的代码片段与调优技巧

✅ 不同大模型厂商的适配经验

✅ 性能数据与成本优化实测对比